ПЕРВАЯ В МИРЕ СИСТЕМА С ИИ НА БАЗЕ NVIDIA A100

NVIDIA DGX™ A100 — это первая в мире универсальная система для всех нагрузок ИИ с производительностью 5 петафлопс, которая обеспечивает высочайшую плотность вычислений и гибкость. NVIDIA DGX A100 оснащена самым мощным в мире графическим ускорителем NVIDIA A100 с тензорными ядрами, который позволяет компаниям объединить анализ данных, тренировку и инференс в унифицированной и простой в развертывании инфраструктуре ИИ с поддержкой экспертов NVIDIA в области ИИ.

КЛЮЧЕВОЙ КОМПОНЕНТ

ДАТА-ЦЕНТРА С ИИ

Универсальная система для любых задач ИИ

С помощью DGX Station A100 организации могут предоставить нескольким пользователям централизованный ресурс ИИ для всех рабочих задач: обучение, инференс, анализ данных. Начав решать эти задачи на DGX Station A100, впоследствии их можно легко перенести в инфраструктуру на базе NVIDIA DGX™ и других систем, сертифицированными NVIDIA. А с помощью Multi-Instance GPU (MIG) можно выделить до 28 отдельных GPU-устройств для отдельных пользователей и задач.

Эксперты по DGX: интегрированный доступ

к экспертным знаниям в

области ИИ

Эксперты NVIDIA по DGX — это более 16 000 специалистов в области ИИ, которые за десять лет накопили богатый опыт и готовы помочь вам максимизировать окупаемость вложений в систему DGX.

Быстрые результаты

NVIDIA DGX A100 — это первая в мире система на базе GPU NVIDIA A100 с тензорными ядрами. Интеграция восьми GPU A100 с объемом памяти до 640 ГБ ускорителей A100 и обеспечивает непревзойденное масштабируемое ускорение, будучи полностью оптимизированной для ПО NVIDIA CUDA-X™ и комплексного стека решений NVIDIA для дата-центра.

Исключительная

масштабируемость

дата-центра

NVIDIA DGX A100 оснащена коммутатором Mellanox с максимальной пропускной способностью 500 Гбит/с. Это одно из многих преимуществ, которые делают DGX A100 ключевым компонентом крупных кластеров ИИ, таких как референсная архитектура для масштабируемых инфраструктур ИИ NVIDIA DGX SuperPOD™.

Простое и быстрое начало работы с ИИ

Набор инструментов NVIDIA AI Starter Kit обеспечивает все необходимое для вашей команды: от передовой платформы ИИ, оптимизированного ПО и инструментов до помощи экспертов, чтобы вы могли быстро начать работу над проектами ИИ. Не теряйте время и деньги на создание платформы ИИ. Настройте систему за один день, создайте проект за неделю и начните разработку моделей гораздо быстрее.

Быстрое решение сложных задач обработки данных

Преимущества

- Откажитесь от долгой настройки и тестирования с использованием оптимизированного ПО для ИИ.

- Получайте более качественные модели быстрее с максимальной производительностью, которая обеспечивает быстрые итерации.

- Не тратьте время на системную интеграцию и разработку ПО.

Развертывание инфраструктуры и начало работы с ИИ

Преимущества

- Оцените простую инфраструктуру и планирование мощности с единой системой для всех задач ИИ.

- Обеспечьте максимальную плотность вычислений и производительность с минимальными ресурсами.

- Используйте встроенную технологию безопасности во всех слоях: от контейнера до чипа.

Ускорьте получение результатов и окупаемость инвестиций в ИИ

Преимущества

- Повысьте эффективность работы специалистов по data science и избавьтесь от действий, не дающих экономического эффекта

- Ускорьте весь цикл разработки, от идеи до конечной версии.

- Устраните трудности с помощью экспертов по DGX.

РЕВОЛЮЦИОННАЯ ПРОИЗВОДИТЕЛЬНОСТЬ

Высокоэффективное обучение алгоритмов повышает продуктивность работы. А это значит, что вы можете быстрее принимать решения и выводить продукты на рынок.

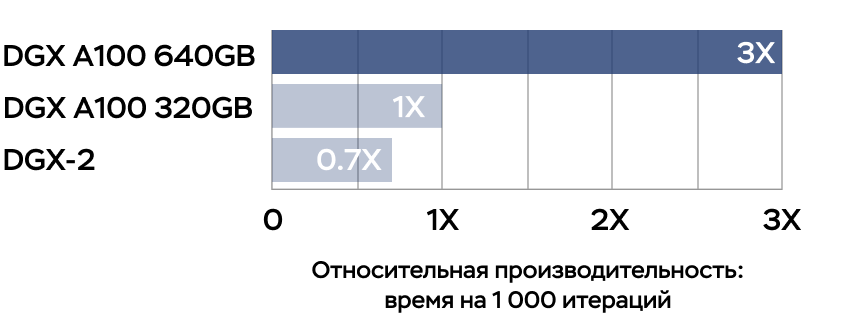

Тренировка

Тренировка DLRM

Повышение производительности

до 3 раз для тренировки ИИ

на самых больших моделях

DLRM на фреймворке HugeCTR, точность = FP16 | 1x DGX A100 640GB размер пакета = 48 | 2x DGX A100 320GB размер пакета = 32 | 1x DGX-2 (16x V100 32GB) размер пакета = 32. Ускорение стандартизовано для количества GPU.

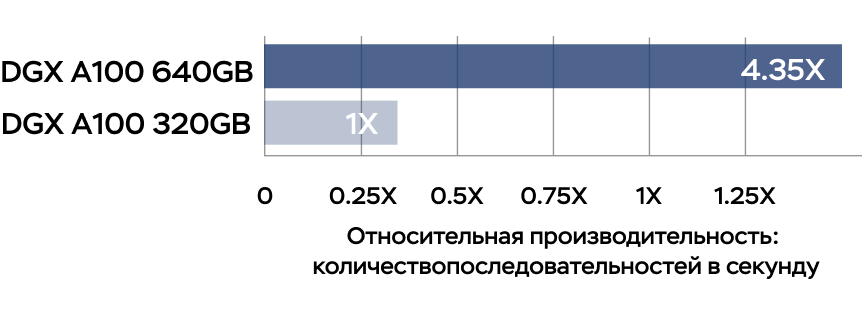

Инференс

Инференс RNN-T: один поток

Повышение производительности

до 1,25 раз для инференса ИИ

MLPerf 0.7 RNN-T измерено с (1/7) инстансами MIG. Фреймворк: TensorRT 7.2, набор данных = LibriSpeech, точность = FP16.

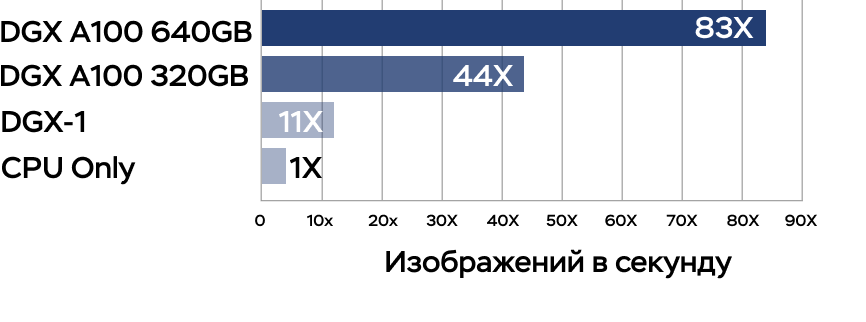

Анализ данных

Бенчмарк анализа больших данных

Повышение производительности до

83 раз по сравнению с процессором и в 2

раза по сравнению с DGX A100 320GB

Бенчмарк анализа больших данных | 30 запросов analytical retail, ETL, машинное обучение, обработка естественного языка на наборе данных 10 TБ | Процессор: 19x Intel Xeon Gold 6252 с тактовой частотой 2,10 ГГц, Hadoop | DGX-1 (8X V100 32GB каждый), RAPIDS/Dask | 12 DGX A100 320GB и 6 DGX A100 640GB, RAPIDS/Dask/BlazingSQL Ускорение стандартизовано для количества GPU.

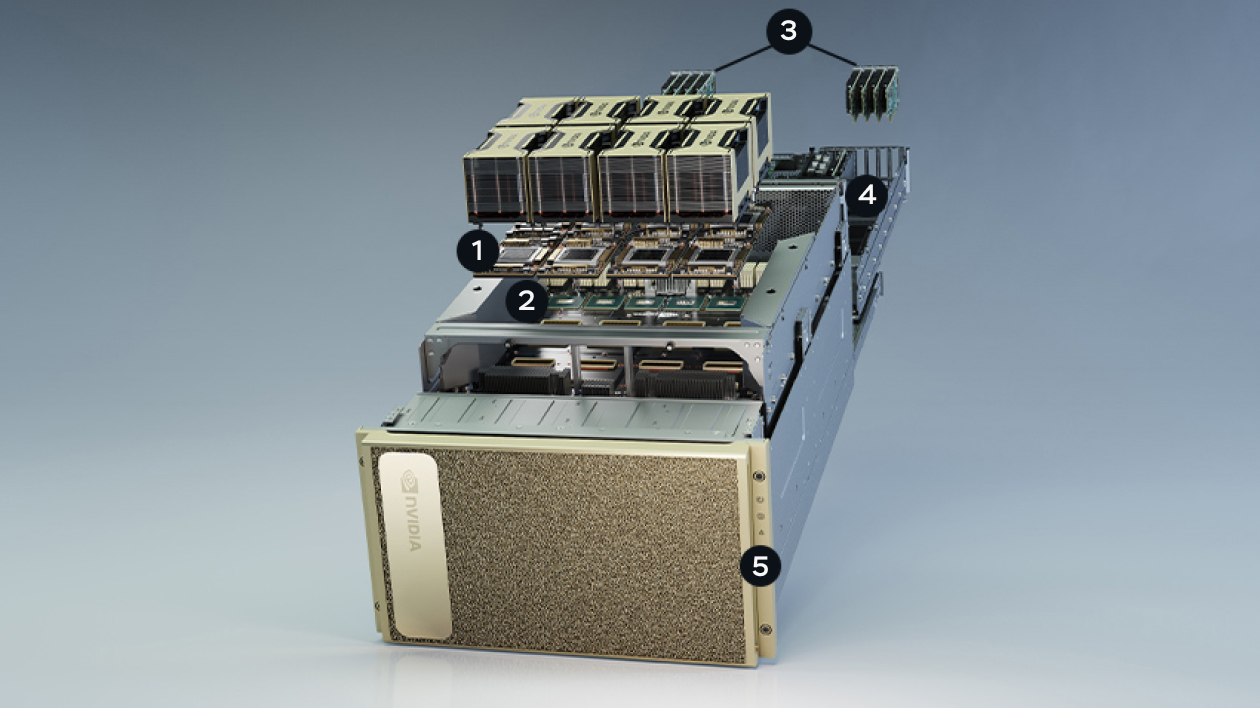

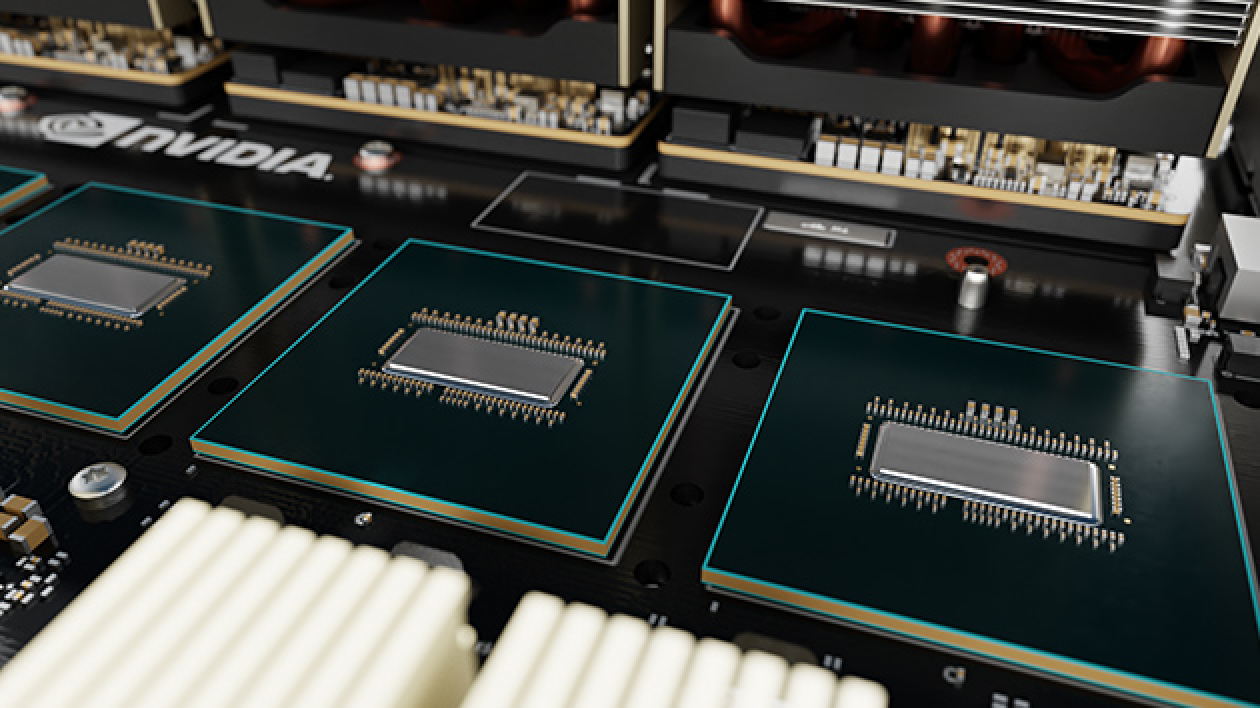

Передовые компоненты системы DGX A100

- 8 GPU NVIDIA A100 С ОБЩИМ ОБЪЕМОМ ПАМЯТИ 640 ГБ 12 соединений NVLink на GPU пропускная способность между GPU 600 Гбит/с

- 6 КОММУТАТОРОВ NVSWITCH ШЕСТОГО ПОКОЛЕНИЯ Двунаправленный интерфейс 4,8 Тбит/с В 2 раза быстрее предыдущего поколения

- 10 адаптеров Mellanox ConnectX-6 VPI HDR/200 GB Ethernet Двунаправленный интерфейс 500 Гбит/с

- Два 64-ядерных процессора AMD И 2 ТБ системной памяти В 2,7 раза больше ядер для самых ресурсоемких задач ИИ

- SSD GEN4 NVME объёмом 30 ТБ Пиковая пропускная способность 50 Гбит/с до 2 раз быстрее, чем SSD Gen3 NVME

Ознакомьтесь с подробным обзором новой

системы NVIDIA DGX A100.

Технологии NVIDIA DGX A100

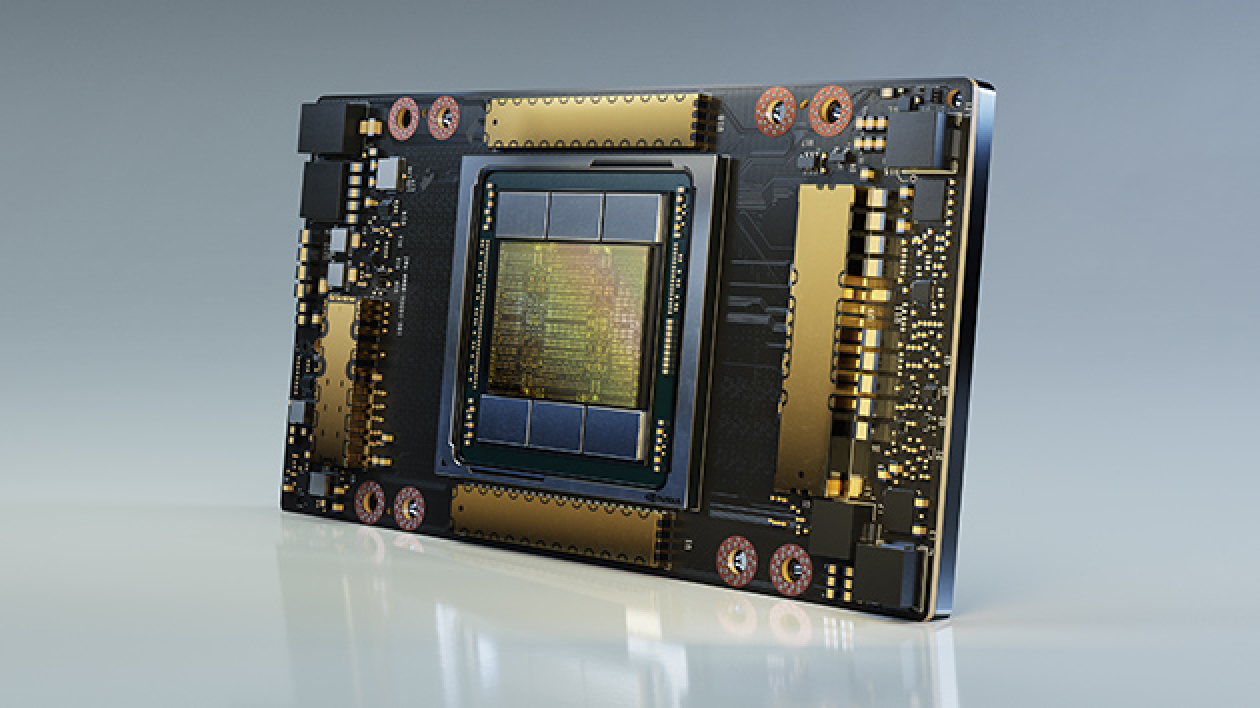

GPU NVIDIA A100 с тензорными ядрами

GPU NVIDIA A100 с тензорными ядрами обеспечивает непревзойденное ускорение для ИИ, анализа данных и высокопроизводительных вычислений (HPC) для решения самых сложных вычислительных задач. Благодаря тензорным ядрам третьего поколения, обеспечивающим значительный прирост производительности, A100 можно масштабировать до тысячи GPU, а с помощью технологии Multi-instance GPU разделить на семь инстансов для ускорения задач любого масштаба.

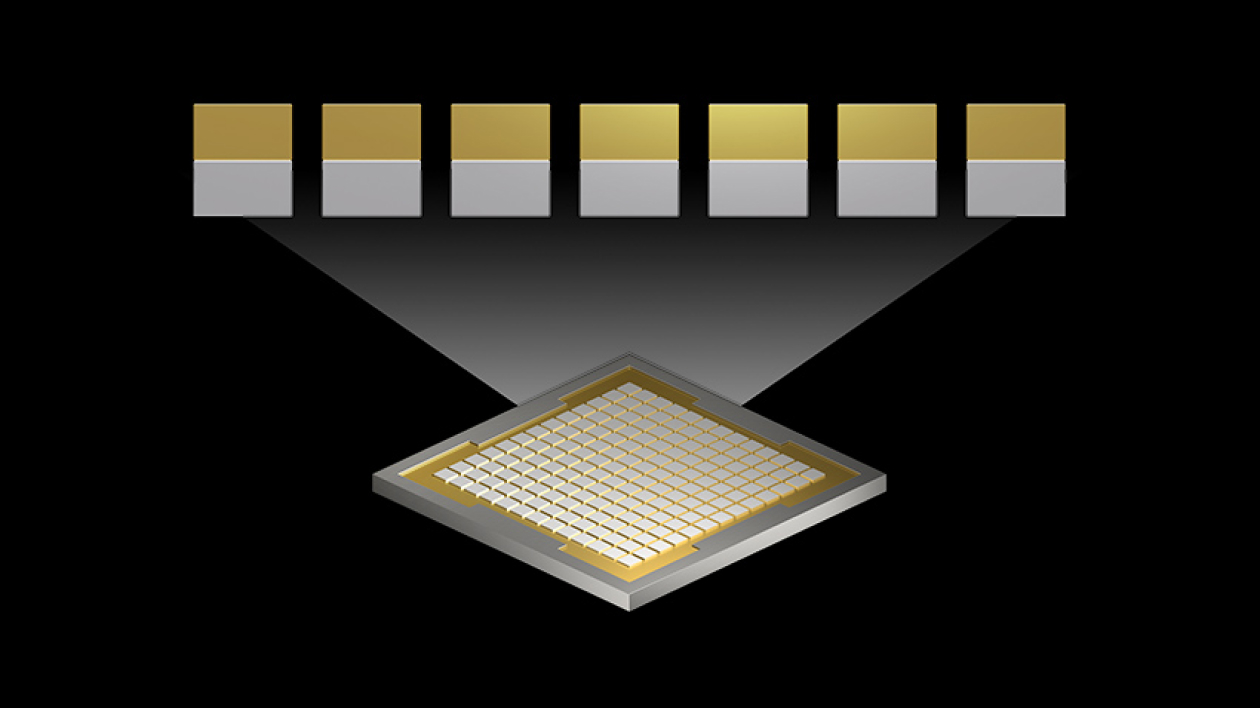

Multi-Instance GPU (MIG)

Технология MIG позволяет разделить 8 ускорителей в DGX A100 на 56 полностью изолированных инстансов, оснащенных памятью с высокой пропускной способностью, кэшем и вычислительными ядрами. Теперь администраторы могут предложить оптимальный размер GPU с гарантированным качеством обслуживания (QoS) для различных задач.

NVLink и NVSwitch нового поколения

Третье поколение NVIDIA® NVLink® в DGX A100 удваивает скорость обмена данными между GPU до 600 Гбит/с, что почти в 10 раз превосходит показатели PCIe Gen 4. DGX A100 также оснащена коммутатором NVIDIA NVSwitch™ нового поколения, который в 2 раза быстрее предыдущих решений.

Mellanox ConnectX-6 VPI HDR InfiniBand

DGX A100 включает в себя новые адаптеры Mellanox ConnectX-6 VPI HDR InfiniBand/Ethernet с пропускной способностью 200 Гбит/с, которые обеспечивают высокоскоростное соединение для задач ИИ.

Оптимизированный стек ПО

DGX A100 содержит протестированный и оптимизированный стек ПО DGX, включая базовую операционную систему для ИИ, все необходимое системное ПО, а также GPU-ускоренные приложения, предварительно натренированные модели и другие ресурсы из NGC™.

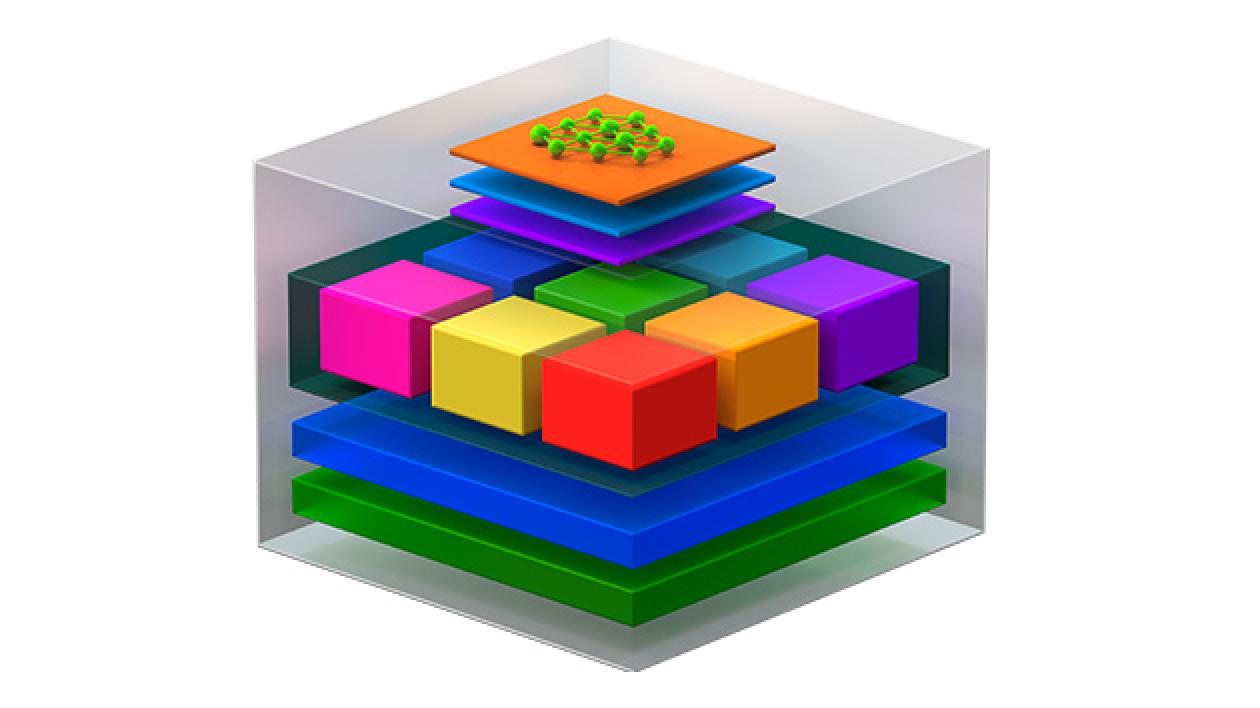

Встроенная технология безопасности

DGX A100 обеспечивает самый надежный уровень безопасности для развертываний ИИ благодаря многоуровневому подходу, который защищает все основные программно-аппаратные компоненты, включая самошифрующиеся диски, контейнеры ПО, управление и мониторинг безопасности и другие решения.

NVIDIA DGX SuperPOD

Передовая инфраструктура ИИ